कैश मेमोरी के विषय में हम सब ने कभी ना कभी सुना जरूर होगा कंप्यूटर में और आजकल तो मोबाइल में भी इसका उपयोग होता है कैश मेमोरी क्या है ,यह काम कैसे करता है और इसकी आवश्यकता क्यों होती है यह हमें आज से पहले नहीं पता होगा |

कैश एक विशेष अति उच्च गति वाली मेमोरी है। इसका उपयोग हाई-स्पीड सीपीयू के साथ गति और सिंक्रनाइज़ करने के लिए किया जाता है। कैश मेमोरी एक अत्यंत तेज़ मेमोरी है जो रैम और सीपीयू के बीच बफर के रूप में कार्य करता है |

यह अक्सर अनुरोधित डेटा और निर्देश रखता है ताकि जरूरत पड़ने पर वे सीपीयू को तुरंत उपलब्ध हों। कैश का उपयोग मेन मेमोरी से डेटा एक्सेस करने में लगने वाले औसत समय को कम करने के लिए किया जाता है।

कैश एक छोटी और तेज़ मेमोरी है जो अक्सर उपयोग किए जाने वाले मुख्य मेमोरी स्थानों से डेटा की प्रतियां संग्रहीत करती है। सीपीयू में कई अलग-अलग स्वतंत्र कैश होते हैं, जो निर्देशों और डेटा को स्टोर करते हैं |

जो कि टेंपरेरी होता है हमारे इस लेख में हम इसी कैश मेमोरी के विषय में संपूर्ण जानकारी देंगे |आप जान पाएंगे कैश मेमोरी क्या है ?और इसके प्रकार के विषय में भी समझने का प्रयास करेंगे| इसके लेवल कौन-कौन से हैं यह कैसे काम करता है और कैश मेमोरी को हम कैसे अपने सिस्टम में बढ़ा सकते हैं इस विषय पर हम चर्चा करेंगे|

- कैश क्या है ? what is cache ?

- कैश मेमोरी के कार्य प्रणाली(functions of cache memory)

- कंप्यूटर कैश परिभाषा

- कैश का मुख्य उद्देश्य क्या है?

- कैश मेमोरी के प्रकार(types of cache memory)

- कैश का परफॉर्मेंस

- कैश के हिट / मिस रेशियो क्या है ?

- कैश मैपिंग

- कैश मैपिंग के प्रकार (Types of Cache Mapping)

- कैश कलरिंग

- Cache Memory Hierarchy

- कैश और रैम में अंतर

- कैश और वर्चुअल मेमोरी में अंतर

- कैश काम कैसे करता है?

- जीपीयू कैश

- कैश कैसे बढ़ाएं

- कैश के लाभ और हानि

- कैश के अन्य उपयोग

- हमने जाना

कैश क्या है ? what is cache ?

computer में हमें कैश मेमोरी प्रोग्राम के इंस्टेंस और प्रोसेसर द्वारा नियमित रूप से एक्सेस किए गए डेटा को स्टोर करके तेजी से डेटा स्टोरेज और एक्सेस प्रदान करती है।

इस प्रकार, जब कोई प्रोसेसर डेटा का अनुरोध करता है जिसका कैश में पहले से ही एक copy है, तो उसे डेटा लाने के लिए मुख्य मेमोरी या हार्ड डिस्क पर जाने की आवश्यकता नहीं होती है।

कैश सबसे तेज उपलब्ध मेमोरी है और रैम और सीपीयू के बीच बफर के रूप में कार्य करती है। प्रोसेसर यह जांचता है कि किसी स्थान को पढ़ने या लिखने के लिए हर बार कैश में संबंधित प्रविष्टि उपलब्ध है या नहीं, इस प्रकार मुख्य मेमोरी से जानकारी तक पहुंचने के लिए आवश्यक समय को कम करता है।

हार्डवेयर कैश को प्रोसेसर कैश भी कहा जाता है, और यह प्रोसेसर का एक भौतिक घटक है। यह प्रोसेसर कोर के कितने करीब है, इस पर निर्भर करते हुए, प्राथमिक या द्वितीयक कैश मेमोरी हो सकती है, प्राथमिक कैश मेमोरी सीधे प्रोसेसर में (या निकटतम) एकीकृत होती है।

गति निकटता के साथ-साथ कैश के आकार पर भी निर्भर करती है। जितना अधिक डेटा कैश में संग्रहीत किया जा सकता है, उतनी ही तेज़ी से यह संचालित होता है,

हार्डवेयर-आधारित कैश के अलावा, कैश मेमोरी एक डिस्क कैश भी हो सकती है, जहां डिस्क पर एक आरक्षित भाग स्टोर करता है और डिस्क से अक्सर एक्सेस किए गए डेटा/एप्लिकेशन तक पहुंच प्रदान करता है।

जब भी प्रोसेसर पहली बार डेटा एक्सेस करता है, तो कैश में एक कॉपी बनाई जाती है। जब उस डेटा को फिर से एक्सेस किया जाता है, यदि कैश में एक कॉपी उपलब्ध है, तो उस कॉपी को पहले एक्सेस किया जाता है

ताकि गति और दक्षता में वृद्धि हो। यदि यह उपलब्ध नहीं है, तो बड़ी, अधिक दूर, और धीमी मेमोरी (जैसे RAM या हार्ड डिस्क) तक पहुंच बनाई जाती है।

आधुनिक वीडियो कार्ड अपने ग्राफिक्स प्रोसेसिंग चिप्स के अंदर अपनी कैश मेमोरी को भी स्टोर करते हैं। इस तरह, उनका GPU सिस्टम की रैम पर भरोसा किए बिना जटिल रेंडरिंग कार्यों को अधिक तेज़ी से पूरा कर सकता है। हार्डवेयर कैश के अलावा, सॉफ़्टवेयर कैश हार्ड डिस्क पर अस्थायी फ़ाइलों को संग्रहीत करने की एक विधि के रूप में भी उपलब्ध है।

यह कैश (ब्राउज़र या एप्लिकेशन कैश के रूप में भी जाना जाता है) का उपयोग उसी कारण से पहले से संग्रहीत फ़ाइलों तक तेज़ी से पहुंचने के लिए किया जाता है: गति बढ़ाना।

उदाहरण के लिए, एक ऑनलाइन ब्राउज़र वेब पेज से कुछ छवियों को कैशिंग करके सहेज सकता है ताकि हर बार उस पेज को फिर से खोलने पर उन्हें फिर से डाउनलोड करने से बचा जा सके।

कैश मेमोरी के कार्य प्रणाली(functions of cache memory)

कैश मेमोरी रैम है। सबसे हाल ही में संसाधित होने वाला डेटा कैश मेमोरी में संग्रहीत किया जाता है। सीपीयू इस डेटा को रैम में डेटा एक्सेस करने की तुलना में अधिक तेज़ी से एक्सेस कर सकता है। जब माइक्रोप्रोसेसर डेटा को प्रोसेस करना शुरू करता है, तो यह सबसे पहले कैशे मेमोरी में चेक करता है।

प्रत्येक कैश ब्लॉक का आकार 1 से 16 बाइट्स तक होता है। प्रत्येक स्थान में एक अनुक्रमणिका होती है जो उस स्थान से मेल खाती है जिसमें एक्सेस करने के लिए डेटा होता है। इस सूचकांक को पते के रूप में जाना जाता है।

प्रत्येक में मेमोरी में इंडेक्स और डेटाम होता है जिसे कैश करने की आवश्यकता होती है।कैश मेमोरी तेज और महंगी है। परंपरागत रूप से, इसे “स्तरों” के रूप में वर्गीकृत किया जाता है जो माइक्रोप्रोसेसर के साथ इसकी निकटता और पहुंच का वर्णन करता है।

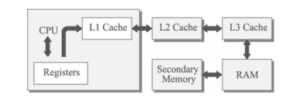

तीन सामान्य कैश स्तर हैं: L1 कैश, या प्राथमिक कैश, बेहद तेज़ लेकिन अपेक्षाकृत छोटा है, और आमतौर पर प्रोसेसर चिप में CPU कैश के रूप में एम्बेडेड होता है।

L2 कैश, या सेकेंडरी कैश, अक्सर L1 की तुलना में अधिक क्षमता वाला होता है। L2 कैश को CPU पर एम्बेड किया जा सकता है, या यह एक अलग चिप या को प्रोसेसर पर हो सकता है और इसमें कैश और CPU को जोड़ने वाली एक हाई-स्पीड वैकल्पिक सिस्टम बस हो सकती है।

इस तरह यह मुख्य सिस्टम बस में यातायात से धीमा नहीं होता है। लेवल 3 (L3) कैश L1 और L2 के प्रदर्शन को बेहतर बनाने के लिए विकसित की गई विशेष मेमोरी है। L1 या L2 L3 की तुलना में काफी तेज हो सकता है, हालांकि L3 आमतौर पर DRAM की गति से दोगुना होता है।

मल्टीकोर प्रोसेसर के साथ, प्रत्येक कोर में समर्पित L1 और L2 कैश हो सकते हैं, लेकिन वे L3 कैश साझा कर सकते हैं। यदि कोई L3 कैश किसी निर्देश का संदर्भ देता है, तो इसे आमतौर पर कैश मेमोरी के उच्च स्तर तक बढ़ाया जाता है। अतीत में, L1, L2 और L3 कैश संयुक्त प्रोसेसर और मदरबोर्ड घटकों का उपयोग करके बनाए गए हैं।

हाल ही में, सीपीयू पर ही मेमोरी कैशिंग के सभी तीन स्तरों को समेकित करने की प्रवृत्ति रही है। यही कारण है कि कैश के आकार को बढ़ाने के लिए प्राथमिक साधन अलग-अलग चिपसेट और बस आर्किटेक्चर के साथ एक विशिष्ट मदरबोर्ड के अधिग्रहण से एकीकृत एल 1, एल 2 और एल 3 कैश की सही मात्रा के साथ सीपीयू खरीदना शुरू कर दिया है।

आम धारणा के विपरीत, एक सिस्टम पर फ्लैश या अधिक गतिशील रैम (dram) लागू करने से कैश मेमोरी में वृद्धि नहीं होगी। यह भ्रमित करने वाला हो सकता है क्योंकि मेमोरी कैशिंग (हार्ड डिस्क बफ़रिंग) और कैश मेमोरी शब्द अक्सर एक दूसरे के लिए उपयोग किए जाते हैं

। मेमोरी कैशिंग, डीआरएएम या फ्लैश टू बफर डिस्क रीड्स का उपयोग, डेटा को कैशिंग करके स्टोरेज I/O को बेहतर बनाने के लिए होता है जिसे अक्सर धीमी चुंबकीय डिस्क या टेप से पहले बफर में संदर्भित किया जाता है। दूसरी ओर, कैश मेमोरी सीपीयू के लिए रीड बफरिंग प्रदान करती है।

कंप्यूटर कैश परिभाषा

कैश मेमोरी एक अस्थायी मेमोरी है जिसे आधिकारिक तौर पर “सीपीयू कैश मेमोरी” कहा जाता है। आपके कंप्यूटर की यह चिप-आधारित सुविधा आपको कुछ जानकारी को अपने कंप्यूटर की मुख्य हार्ड ड्राइव से एक्सेस करने की तुलना में अधिक तेज़ी से एक्सेस करने देती है।

आपके द्वारा सबसे अधिक उपयोग किए जाने वाले प्रोग्राम और फ़ाइलों का डेटा इस अस्थायी मेमोरी में संग्रहीत किया जाता है, जो आपके कंप्यूटर की सबसे तेज़ मेमोरी भी है।

कैश का मुख्य उद्देश्य क्या है?

कैश मेमोरी अस्थायी रूप से सीपीयू द्वारा उपयोग की जाने वाली जानकारी, डेटा और प्रोग्राम को अस्थायी रूप से संग्रहीत करती है। जब डेटा की आवश्यकता होती है, तो सीपीयू तेजी से डेटा एक्सेस की तलाश में स्वचालित रूप से कैश मेमोरी में घूम जाएगा |

कैश मेमोरी के प्रकार(types of cache memory)

लेवल 1 या रजिस्टर

यह एक प्रकार की मेमोरी होती है जिसमें डेटा को स्टोर किया जाता है और स्वीकार किया जाता है जो तुरंत सीपीयू में स्टोर हो जाता है। सबसे अधिक इस्तेमाल किया जाने वाला रजिस्टर एक्यूमुलेटर, प्रोग्राम काउंटर, एड्रेस रजिस्टर आदि है।

लेवल 2 या कैश

यह सबसे तेज़ मेमोरी है जिसमें तेज़ पहुँच समय होता है जहाँ डेटा को तेज़ पहुँच के लिए अस्थायी रूप से संग्रहीत किया जाता है।

लेवल 3 या मुख्य मेमोरी

यह मेमोरी है जिस पर वर्तमान में कंप्यूटर काम करता है। यह आकार में छोटा है और एक बार बिजली बंद हो जाने के बाद डेटा इस मेमोरी में नहीं रहता है।

लेवल 4 या सेकेंडरी मेमोरी

यह बाहरी मेमोरी है जो मुख्य मेमोरी जितनी तेज नहीं होती है लेकिन डेटा इस मेमोरी में स्थायी रूप से रहता है।

कैश का परफॉर्मेंस

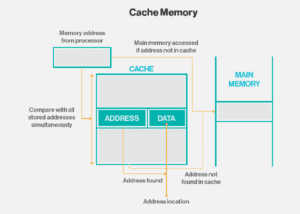

जब प्रोसेसर को मुख्य मेमोरी में किसी स्थान को पढ़ने या लिखने की आवश्यकता होती है, तो यह पहले कैश में संबंधित प्रविष्टि की जांच करता है। यदि प्रोसेसर को पता चलता है कि मेमोरी लोकेशन कैश में है, तो कैश हिट हुआ है और कैशे से डेटा पढ़ा जाता है

यदि प्रोसेसर को कैश में मेमोरी लोकेशन नहीं मिलती है, तो कैश मिस हो गया है। कैश मिस के लिए, कैश एक नई प्रविष्टि आवंटित करता है और मुख्य मेमोरी से डेटा में कॉपी करता है, फिर कैश की सामग्री से अनुरोध पूरा किया जाता है |

प्रौद्योगिकी-स्केलिंग के साथ, जिसने मेमोरी सिस्टम को एक चिप पर समायोजित करने की अनुमति दी, अधिकांश आधुनिक प्रोसेसर में तीन या चार कैश मेमोरी स्तर होते हैं। AAT में कमी को इस उदाहरण से समझा जा सकता है, जहां कंप्यूटर एल3 कैश तक विभिन्न कॉन्फ़िगरेशन के लिए एएटी की जांच करता है।

Example: main memory = 50 ns, L1 = 1 ns with 10% miss rate, L2 = 5 ns with1% miss rate), L3 = 10 ns with 0.2% miss rate.

No cache, AAT = 50 ns

L1 cache, AAT = 1 ns + (0.1 × 50 ns) = 6 ns

L1–2 caches, AAT = 1 ns + (0.1 × [5 ns + (0.01 × 50 ns)]) = 1.55 ns

L1–3 caches, AAT = 1 ns + (0.1 × [5 ns + (0.01 × [10 ns + (0.002 × 50 ns)])]) = 1.5101 ns

कैश के हिट / मिस रेशियो क्या है ?

जब आप कोई ऐसा कार्य करते हैं जिसमें उस जानकारी की आवश्यकता होती है, तो कंप्यूटर पहले कैश मेमोरी की जांच करता है। यदि यह वहां है, तो इसे “हिट” कहा जाता है और आप चरम प्रदर्शन प्राप्त करेंगे। यदि डेटा नहीं है, तो यह “मिस” है, और आपका पीसी आपकी हार्ड ड्राइव या रैम में इसे खोजने का लंबा और धीमा मार्ग लेगा।

कैश मेमोरी का प्रदर्शन अक्सर हिट अनुपात नामक मात्रा के संदर्भ में मापा जाता है।

हिट अनुपात = हिट / (हिट + मिस) = total हिट/कुल पहुंच का हम उच्च कैश ब्लॉक आकार,

उच्च सहयोगीता का उपयोग करके कैश प्रदर्शन में सुधार कर सकते हैं, मिस रेट कम कर सकते हैं, मिस पेनल्टी कम कर सकते हैं और कैश में हिट करने के लिए समय कम कर सकते हैं।

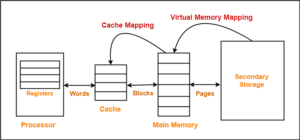

कैश मैपिंग

कैश मेमोरी सीपीयू सिधे तौर पर कनेक्टेड होता है कैश से ,और कैश सिधे तौर पर कनेक्टेड होता है ram से , और ram सिधे तौर पर कनेक्टेड होता है सेकेंडरी मेमोरी से मतलब हार्ड डिस्क से ,

कैश के उद्देश्य के लिए तीन अलग-अलग प्रकार की मैपिंग का उपयोग किया जाता है जो इस प्रकार हैं: डायरेक्ट मैपिंग, एसोसिएटिव मैपिंग और सेट-एसोसिएटिव मैपिंग। इन्हें नीचे समझाया गया है।

कैश मैपिंग के प्रकार (Types of Cache Mapping)

a) डायरेक्ट मैपिंग b) एसोसिएटिव मैपिंग c) सेट-एसोसिएटिव मैपिंग

a) डायरेक्ट कैश मैपिंग

कैश मेमोरी डायरेक्ट मैपिंग के रूप में जानी जाने वाली सबसे सरल तकनीक, मुख्य मेमोरी के प्रत्येक ब्लॉक को केवल एक संभावित कैश लाइन में मैप करती है। या डायरेक्ट मैपिंग में, प्रत्येक मेमोरी ब्लॉक को कैशे में एक विशिष्ट लाइन पर असाइन करें।

यदि किसी नए ब्लॉक को लोड करने की आवश्यकता होने पर मेमोरी ब्लॉक द्वारा पहले एक लाइन ली जाती है, तो पुराना ब्लॉक ट्रैश हो जाता है। एक पता स्थान दो भागों में विभाजित है

अनुक्रमणिका फ़ील्ड और एक टैग फ़ील्ड। कैश का उपयोग टैग फ़ील्ड को संग्रहीत करने के लिए किया जाता है जबकि शेष को मुख्य मेमोरी में संग्रहीत किया जाता है। डायरेक्ट मैपिंग का प्रदर्शन हिट अनुपात के सीधे आनुपातिक है।

i = j modulo m

where

i=cache line number

j= main memory block number

m=number of lines in the cache

कैश एक्सेस के प्रयोजनों के लिए, प्रत्येक मुख्य मेमोरी एड्रेस को तीन क्षेत्रों से मिलकर देखा जा सकता है। कम से कम महत्वपूर्ण w बिट्स मुख्य

मेमोरी के एक ब्लॉक के भीतर एक अद्वितीय शब्द या बाइट की पहचान करते हैं। अधिकांश समकालीन मशीनों में, पता बाइट स्तर पर होता है। शेष s बिट्स मुख्य मेमोरी के 2s ब्लॉकों में से एक को निर्दिष्ट करते हैं।

कैश लॉजिक इन s बिट्स को s-r बिट्स (सबसे महत्वपूर्ण भाग) के टैग और r बिट्स के एक लाइन फ़ील्ड के रूप में व्याख्या करता है। यह बाद वाला क्षेत्र कैश की m=2r पंक्तियों में से एक की पहचान करता है।

b) एसोसिएटिव कैश मैपिंग

इस प्रकार की मैपिंग में, साहचर्य स्मृति का उपयोग स्मृति शब्द की सामग्री और पते को संग्रहीत करने के लिए किया जाता है। कोई भी ब्लॉक कैश की किसी भी लाइन में जा सकता है।

इसका मतलब यह है कि आईडी बिट्स शब्द का उपयोग यह पहचानने के लिए किया जाता है कि ब्लॉक में किस शब्द की आवश्यकता है, लेकिन टैग शेष सभी बिट्स बन जाता है।

यह किसी भी शब्द को कैशे मेमोरी में किसी भी स्थान पर रखने में सक्षम बनाता है। इसे सबसे तेज और सबसे लचीला मैपिंग फॉर्म माना जाता है।

c) सेट-एसोसिएटिव मैपिंग

मानचित्रण का यह रूप प्रत्यक्ष मानचित्रण का एक उन्नत रूप है जहाँ प्रत्यक्ष मानचित्रण की कमियों को दूर किया जाता है। सेट एसोसिएटिव डायरेक्ट मैपिंग विधि में संभावित थ्रैशिंग की समस्या का समाधान करता है।

यह यह कहकर करता है कि कैश में एक ब्लॉक मैप करने के लिए बिल्कुल एक लाइन होने के बजाय, हम एक सेट बनाने के लिए कुछ पंक्तियों को एक साथ समूहित करेंगे। फिर मेमोरी में एक ब्लॉक किसी विशिष्ट सेट की किसी एक लाइन को मैप कर सकता है।

सेट-एसोसिएटिव मैपिंग की अनुमति देता है कि कैश मेमोरी में मौजूद प्रत्येक शब्द में एक ही इंडेक्स एड्रेस के लिए मुख्य मेमोरी में दो या दो से अधिक शब्द हो सकते हैं। सहयोगी कैश मैपिंग सेट करें जो प्रत्यक्ष और सहयोगी कैश मैपिंग तकनीकों का सर्वोत्तम संयोजन करता है। इस मामले में, कैश में कई सेट होते हैं, जिनमें से प्रत्येक में कई लाइनें होती हैं।

m = v * k i= j mod v where i=cache set number j=main memory block number v=number of sets m=number of lines in the cache number of sets k=number of lines in each set

कैश कलरिंग

कंप्यूटर विज्ञान में, कैश कलरिंग (पेज कलरिंग के रूप में भी जाना जाता है) प्रोसेसर द्वारा कैश किए गए पृष्ठों की कुल संख्या को अधिकतम करने के लिए सीपीयू कैश मेमोरी के दृष्टिकोण से मुक्त पृष्ठों को आवंटित करने का प्रयास करने की प्रक्रिया है।

वर्चुअल मेमोरी को भौतिक मेमोरी में मैप करते समय, ऑपरेटिंग सिस्टम में कैश कलरिंग को आमतौर पर निम्न-स्तरीय गतिशील मेमोरी आवंटन कोड द्वारा नियोजित किया जाता है। एक वर्चुअल मेमोरी सबसिस्टम जिसमें कैशे रंग की कमी होती है |

कैश प्रदर्शन के संबंध में कम नियतात्मक होता है, क्योंकि एक प्रोग्राम से दूसरे प्रोग्राम में पेज आवंटन में अंतर प्रोग्राम के प्रदर्शन में बड़े अंतर पैदा कर सकता है।

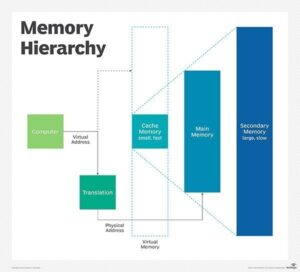

Cache Memory Hierarchy

कैश मेमोरी हायरार्की, या बहु-स्तरीय कैश, एक मेमोरी आर्किटेक्चर को संदर्भित करता है जो कैश डेटा तक अलग-अलग पहुंच गति के आधार पर मेमोरी स्टोर्स के पदानुक्रम का उपयोग करता है। अत्यधिक अनुरोधित डेटा को हाई-स्पीड एक्सेस मेमोरी स्टोर्स में कैश किया जाता है|

जिससे सेंट्रल प्रोसेसिंग यूनिट (सीपीयू) कोर द्वारा तेजी से एक्सेस की अनुमति मिलती है। कैश पदानुक्रम स्मृति पदानुक्रम का एक रूप और हिस्सा है और इसे स्तरीय भंडारण का एक रूप माना जा सकता है।

इस डिज़ाइन का उद्देश्य मुख्य मेमोरी एक्सेस की मेमोरी विलंबता के बावजूद CPU कोर को तेज़ी से संसाधित करने की अनुमति देना था। मुख्य मेमोरी तक पहुंच सीपीयू कोर प्रदर्शन के लिए एक अड़चन के रूप में कार्य कर सकती है क्योंकि सीपीयू डेटा की प्रतीक्षा करता है |

जबकि सभी मुख्य मेमोरी को हाई-स्पीड बनाना निषेधात्मक रूप से महंगा हो सकता है। हाई-स्पीड कैश एक समझौता है जो सीपीयू द्वारा सबसे अधिक उपयोग किए जाने वाले डेटा तक हाई-स्पीड एक्सेस की अनुमति देता है, जिससे तेज सीपीयू घड़ी की अनुमति मिलती है।

कैश और रैम में अंतर

DRAM कंप्यूटर की मुख्य मेमोरी के रूप में कार्य करता है, भंडारण से प्राप्त डेटा पर गणना करता है। DRAM और कैशे मेमोरी दोनों अस्थिर मेमोरी हैं जो बिजली बंद होने पर अपनी सामग्री खो देती हैं।

DRAM मदरबोर्ड पर स्थापित होता है, और CPU इसे बस कनेक्शन के माध्यम से एक्सेस करता है। DRAM आमतौर पर L1, L2 या L3 कैश मेमोरी से लगभग आधा तेज़ होता है, और बहुत कम खर्चीला होता है।

यह फ्लैश स्टोरेज, हार्ड डिस्क ड्राइव (एचडीडी) और टेप स्टोरेज की तुलना में तेज डेटा एक्सेस प्रदान करता है। यह पिछले कुछ दशकों में I/O प्रदर्शन को बेहतर बनाने के लिए अक्सर एक्सेस किए गए डिस्क डेटा को स्टोर करने के लिए जगह प्रदान करने के लिए उपयोग में आया।

DRAM को हर कुछ मिलीसेकंड में ताज़ा किया जाना चाहिए। कैश मेमोरी, जो एक प्रकार की रैंडम एक्सेस मेमोरी भी है, को रीफ्रेश करने की आवश्यकता नहीं है। यह प्रोसेसर को मेमोरी लोकेशन तक सबसे तेज संभव एक्सेस देने के लिए सीधे सीपीयू में बनाया गया है

और अक्सर संदर्भित निर्देशों और डेटा को नैनोसेकंड स्पीड एक्सेस टाइम प्रदान करता है। एसआरएएम डीआरएएम से तेज है, लेकिन क्योंकि यह एक अधिक जटिल चिप है, इसलिए इसे बनाना भी अधिक महंगा है।

कैश और वर्चुअल मेमोरी में अंतर

एक कंप्यूटर में सीमित मात्रा में DRAM और उससे भी कम कैश मेमोरी होती है। जब एक बड़ा प्रोग्राम या कई प्रोग्राम चल रहे हों, तो मेमोरी का पूरी तरह से उपयोग करना संभव है।

भौतिक मेमोरी की कमी को पूरा करने के लिए, कंप्यूटर का ऑपरेटिंग सिस्टम (OS) वर्चुअल मेमोरी बना सकता है। ऐसा करने के लिए, OS अस्थायी रूप से निष्क्रिय डेटा को DRAM से डिस्क संग्रहण में स्थानांतरित करता है। यह दृष्टिकोण डीआरएएम में सक्रिय मेमोरी और एचडीडी में निष्क्रिय मेमोरी का उपयोग करके वर्चुअल एड्रेस स्पेस को बढ़ाता है

ताकि एक एप्लिकेशन और उसके डेटा दोनों को रखने वाले सन्निहित पते बन सकें। वर्चुअल मेमोरी एक कंप्यूटर को एक साथ बड़े प्रोग्राम या कई प्रोग्राम चलाने देती है, और प्रत्येक प्रोग्राम ऐसे संचालित होता है जैसे कि उसमें असीमित मेमोरी हो। वर्चुअल मेमोरी को फिजिकल मेमोरी में कॉपी करने के लिए, OS मेमोरी को पेज फाइल्स या स्वैप फाइल्स में विभाजित करता है

जिसमें एक निश्चित संख्या में एड्रेस होते हैं। उन पृष्ठों को एक डिस्क पर संग्रहीत किया जाता है और जब उनकी आवश्यकता होती है, ओएस उन्हें डिस्क से मुख्य मेमोरी में कॉपी करता है और वर्चुअल मेमोरी एड्रेस को एक भौतिक में अनुवाद करता है। इन अनुवादों को स्मृति प्रबंधन इकाई (एमएमयू) द्वारा नियंत्रित किया जाता है।

कैश काम कैसे करता है?

कैश मेमोरी कैशिंग पहले RAM के एक हिस्से को कैश के रूप में उपयोग करने के लिए अलग सेट करके काम करता है। चूंकि कोई एप्लिकेशन डेटा को पढ़ने की कोशिश करता है, आमतौर पर डेटाबेस जैसे डेटा स्टोरेज सिस्टम से, यह यह देखने के लिए जांच करता है कि वांछित रिकॉर्ड कैश में पहले से मौजूद है या नहीं।

यदि ऐसा होता है, तो एप्लिकेशन कैश से डेटा पढ़ेगा, इस प्रकार डेटाबेस तक धीमी पहुंच को समाप्त कर देगा। यदि वांछित रिकॉर्ड कैश में नहीं है, तो एप्लिकेशन स्रोत से रिकॉर्ड पढ़ता है। जब यह उस डेटा को पुनः प्राप्त करता है, तो यह डेटा को कैशे में भी लिखता है ताकि जब भविष्य में एप्लिकेशन को उसी डेटा की आवश्यकता हो|

तो वह इसे कैश से जल्दी से प्राप्त कर सके। चूंकि कैश आकार में सीमित है, अंततः कैश में पहले से मौजूद कुछ डेटा को नए डेटा के लिए जगह बनाने के लिए निकालना होगा जिसे एप्लिकेशन ने हाल ही में एक्सेस किया है। इसका मतलब है कि कैशिंग सिस्टम को एक रणनीति की आवश्यकता होती है |

जिस पर रिकॉर्ड बनाने के लिए जगह बनाई जाए। रणनीति एप्लिकेशन के डेटा एक्सेस की प्रकृति पर निर्भर करेगी, और आम तौर पर उन रिकॉर्ड्स को हटाने का प्रयास करेगी जिन्हें जल्द ही फिर से एक्सेस करने की उम्मीद नहीं है। उदाहरण के लिए, हाल ही में उपयोग की गई (LRU) रणनीति उस रिकॉर्ड को हटा देगी|

जिसका अंतिम एक्सेस कैश में किसी अन्य रिकॉर्ड से पहले था। यहां धारणा यह है कि यदि रिकॉर्ड को एक्सेस किए हुए काफी समय हो गया है, तो संभवत: जल्द ही इसे फिर से एक्सेस नहीं किया जाएगा। या इसे दूसरे तरीके से कहें, तो हाल ही में जिन रिकॉर्ड्स का सबसे अधिक उपयोग किया गया था

उनके जल्द ही फिर से उपयोग किए जाने की संभावना है। कम से कम बार-बार उपयोग की जाने वाली (LFU) रणनीति में कैश में प्रत्येक रिकॉर्ड की एक्सेस की संख्या को ट्रैक करना और कम से कम एक्सेस के साथ रिकॉर्ड को हटाना शामिल है। यहां धारणा यह है कि शायद ही कभी इस्तेमाल किए गए रिकॉर्ड का जल्द ही फिर से उपयोग नहीं किया जाएगा |

जीपीयू कैश

ग्राफिक्स रेंडर करने के लिए आवश्यक डेटा प्राप्त करना बहुत जल्दी होना चाहिए, इसलिए यह केवल यह समझ में आता है कि यह कैश सिस्टम का उपयोग करता है। यदि आपके कंप्यूटर के ग्राफिक्स एकीकृत हैं, तो उन्हें एक ग्राफिक्स प्रोसेसिंग यूनिट (जीपीयू) द्वारा नियंत्रित किया जाएगा जो एक चिप में सीपीयू के साथ संयुक्त है।

दोनों फ़ंक्शन समान संसाधनों से काम करते हैं, इसलिए GPU कैश भी सीमित है। एक अलग, समर्पित ग्राफिक्स कार्ड (जिसे “असतत ग्राफिक्स” भी कहा जाता है) सीपीयू से अलग होगा और इसके स्वयं के कैश मेमोरी के साथ भी आएगा।

सबसे तेज़ गेमिंग कंप्यूटर में एक समर्पित ग्राफिक्स कार्ड होगा जिसमें पर्याप्त कैश स्टोर होंगे जो सीधे GPU में बनाए गए हैं ताकि तीव्र गेम के साथ अंतराल या हकलाना से बचा जा सके।

कैश कैसे बढ़ाएं

कैश मेमोरी को ध्यान में रखकर कैसे खरीदें अधिकांश लोग कैश के बारे में सोचकर नए कंप्यूटर की खरीदारी नहीं करते हैं। हालांकि, यह ध्यान देने योग्य है कि यदि आप कम अंतराल और कम देरी के साथ सबसे आसान कंप्यूटर अनुभव प्राप्त करने में रुचि रखते हैं, खासकर जब एक साथ कई प्रक्रियाएं चला रहे हों।

अतिरिक्त कैश विचारों में कैश का size और latency शामिल है। आकार हां, यह सच है कि बड़े कैश में अधिक डेटा होता है। लेकिन यह भी धीमा है साथ ही, कंप्यूटर अलग-अलग कैश में डेटा को प्राथमिकता देने के लिए बनाए गए हैं। इसलिए उनके पास कैश स्तर हैं। यदि L1 कैश में पर्याप्त जगह नहीं है|

तो वह इसे L2 कैश में संग्रहीत कर सकता है। नतीजतन, खरीदारी करते समय कैश का आकार मुख्य विचार नहीं होना चाहिए। विलंब डेटा तक पहुँचने के प्रयोजनों के लिए, विलंबता को “गति” के रूप में सोचें। आपके पीसी को उस एल2 मेमोरी कैश तक पहुंचने में कितना समय लगता है?

यदि यह एक छोटा कैश है, तो यह तेज़ हो जाएगा। 3MB कैश की तुलना में 6MB L2 कैश में विलंबता बढ़ जाएगी। उच्च अंत वाले कंप्यूटर एक मल्टीसिस्टम दृष्टिकोण का उपयोग करते हैं जो डेटा को अतिरिक्त छोटे कैश में रखता है। यह बेहतर समग्र विलंबता के साथ अधिक जानकारी रखने की समस्या को हल करता है।

कैश के लाभ और हानि

कैश के कुछ फायदे

कैश मेमोरी प्राइमरी मेमोरी और सेकेंडरी मेमोरी की तुलना में बहुत तेज होती है। यह सीपीयू द्वारा अक्सर उपयोग किए जाने वाले सभी डेटा और निर्देशों को संग्रहीत करता है, जिससे सीपीयू के प्रदर्शन में वृद्धि होती है। कैशे मेमोरी का डेटा एक्सेस टाइम प्राइमरी मेमोरी से कम होता है।

कैश के कुछ नुकसान

यह बाकी मेमोरी (जैसे – प्राइमरी मेमोरी और सेकेंडरी मेमोरी) की तुलना में बहुत अधिक महंगी होती है। इसकी भंडारण क्षमता काफी आसान है। यह डेटा को अस्थायी रूप से स्टोर करता है। जब कंप्यूटर को बंद कर दिया जाता है, तो उसमें संग्रहीत डेटा नष्ट हो जाता है

कैश के अन्य उपयोग

कैश मेमोरी का उपयोग डेटा के किसी भी अस्थायी संग्रह को संदर्भित करने के लिए भी किया जाता है, या तो हार्डवेयर या सॉफ़्टवेयर में। उदाहरण के लिए, नियमित रखरखाव का सुझाव है कि आप अपने कंप्यूटर, राउटर और मॉडेम को नियमित रूप से “कैश साफ़ करें” के लिए पुनरारंभ करें |

जिससे आपके डिवाइस प्रोग्राम को तेज़ी से लोड कर सकें। जब आप अपने ब्राउज़र कुकीज़ को मिटाने और खोजने के लिए अपने Google इतिहास में जाते हैं, तो विकल्पों में से एक “कैश्ड इमेज” को साफ़ करना है। जब कंप्यूटर में तकनीकी विशेषज्ञ कैश के बारे में बात करते हैं, तो वे सबसे अधिक संभावना कैश मेमोरी की बात करते हैं।

हमने जाना

मुझे उम्मीद है हमारा यह लेख कैश मेमोरी आप को जरूर पसंद आया होगा इस लेख में हमने जाना कैश मेमोरी क्या है और उसके कार्य प्रणाली के विषय में हमने विस्तार से जाना

हमने इसके तीनों प्रकार के विषय में भी जाना है और इसके विभिन्न लेवल कौन-कौन से हैं इस पर भी संक्षिप्त जानकारी दी है हमने जाना कि कैसे कैश मेमोरी को कैसे बढ़ा सकते हैं कैश के लाभ और हानि और उसके दूसरे उपयोग के विषय में भी हमने संक्षिप्त में जाना है